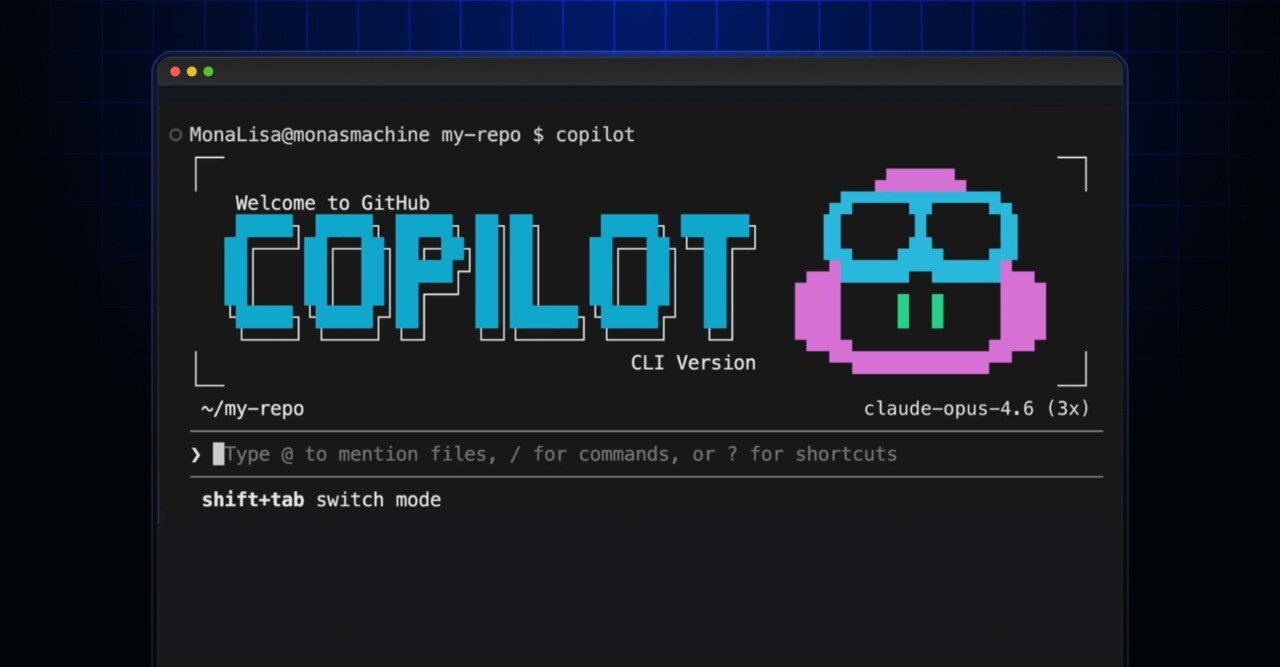

GitHubは4月6日(現地時間)、Copilot CLIに新たな実験的機能「Rubber Duck」を追加し、AIコーディング性能を大幅に引き上げたと発表しました。GitHubのテストでは、Claude SonnetがClaude Opusに対して持っていた性能差の約74.7%を埋めることに成功したとされています。

Rubber Duck(ラバーダック)は、プログラミングでおなじみの「問題を声に出して説明することで理解を深める」手法を、第二のLLMを使って自動化した仕組みです。

Copilot CLIでは、別系統のLLM(GPT‑5.4)が、エージェントの作成した計画やコードをレビューし、早い段階での誤りや非効率を指摘するという役割を担います。これにより、従来の「自己レビュー」では避けられなかった同じモデル由来のバイアスや盲点を補完できる点が大きな特徴です。

複雑な問題に効果あり

GitHubの研究によると、Rubber Duckは特に以下のようなケースで効果を発揮します。

- 3ファイル以上にまたがる複雑な問題

- 70ステップ以上を要する長いタスク

- エージェントがループに陥ったときの脱出支援

Rubber Duckは計画作成直後や、複雑な実装後、テスト作成後に自動的に呼び出されることがあるほか、ユーザーが任意のタイミングで手動呼び出しすることも可能です。

利用方法

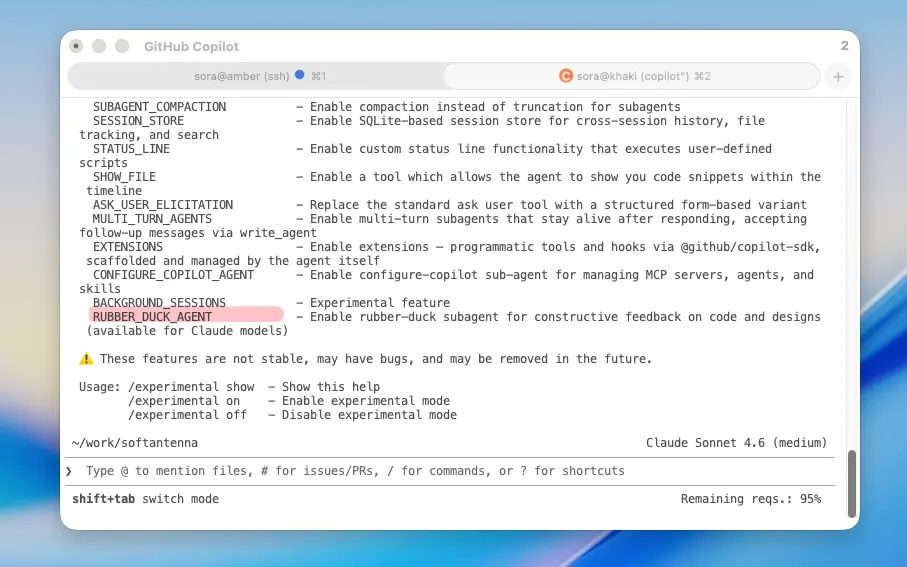

Rubber DuckはCopilot CLIの/experimentalコマンドから利用できます。

現時点ではモデルピッカーでClaude系モデルを選択し、Rubber Duck用にGPT‑5.4へアクセス可能であることが条件で、設定後は自動・手動の両方でRubber Duckが動作します。

まとめ

GitHub Copilot CLIの新機能「Rubber Duck」は、第二のLLMによる計画レビューというアプローチで、AIコーディングの弱点だった「初期判断の誤り」を大幅に改善するものです。特に大規模・複雑なタスクでの性能向上が期待され、今後のAIコーディングエージェントの進化を象徴する機能と言えます。