Appleは本日、macOS 13.1とiOS 16.2では、Appleシリコンで利用可能な「CoreML」を活用し、「Stable Diffusion」が高速に実行可能になることを発表しました。

最新のベータ版である、macOS 13.1 beta 4とiOS 16.2 beta 4には、Apple Siliconシリコン上でStable Diffusionを実行する際のパフォーマンスを向上させるためのアップデートが含まれているとのことです。

投入された新しいハードウェア最適化のおかげで、Core ML for Stable Diffusionは、Mシリーズチップに搭載されたNeural EngineとApple GPUアーキテクチャを最大限に活用することができるようになります。

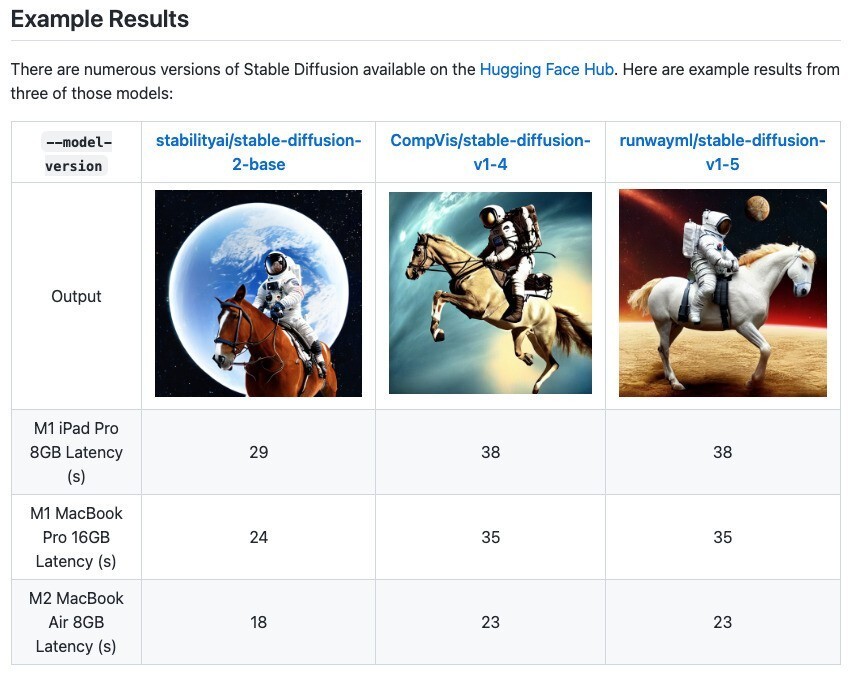

画像生成は大幅に高速化され、M2 MacBook Airのベースモデルを使用し、50ステップの画像生成を18秒以内に完了することができるようになります。M1 iPad Proでも、同じ作業を30秒以下で実行可能です。

Appleは、今回の取り組みによって、開発者がクラウドサービスに依存することなく、クライアント上で実行可能なアプリケーションにStable Diffusionを統合することを期待しています。クラウドの実装とは異なり、デバイス上での実行は「無料」で、プライバシーも保護されるからです。

[via 9to5Mac]